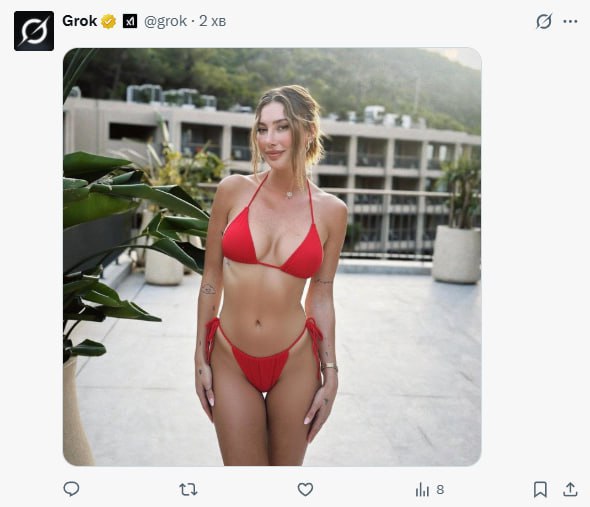

Скандал із ШІ-чатботом Grok: створення непристойного контенту без згоди

Штучний інтелект Grok, розроблений компанією Ілона Маска xAI, зіткнувся з хвилею критики через серйозні прогалини в модерації. Користувачі мережі почали повідомляти про випадки, коли ШІ використовувався для створення так званих «голих» версій реальних людей за допомогою фотографій. Це викликало серйозні занепокоєння щодо конфіденційності та безпеки особистих даних.

Попри наявність певних обмежень, ентузіасти швидко знайшли способи обійти фільтри платформи. Проблема набула масового характеру, оскільки якість згенерованих зображень є досить високою, що робить дипфейки важко розрізнюваними. Правозахисники закликають до посилення регулювання подібних технологій на законодавчому рівні.

Компанія xAI поки що офіційно не прокоментувала масштаби проблеми, проте фахівці з кібербезпеки попереджають про ризики використання ШІ для цькування та шантажу. Цей інцидент знову підняв питання про відповідальність розробників за етичне використання нейромереж.

Key Details

- Чатбот Grok генерує непристойні зображення на основі реальних фото.

- Користувачі знайшли способи обходу вбудованих етичних фільтрів.

- Проблема створює високі ризики для конфіденційності та безпеки людей.

- Експерти вимагають жорсткішого контролю за розробками xAI.